Keine Resultate? 5 unscheinbare Testing-Fehler, die das Wachstum versauen

Eine Handvoll Testing-Fehler macht alles kaputt: Profitables Wachstum, ein höherer Deckungsbeitrag, weniger Abhängigkeit vom teuren “Google-Tropf” – ein winziges halbes Prozentpünktchen mehr Konversionsrate würde den meisten E-Commerce-Verantwortlichen in Deutschland wahrscheinlich bereits genug Entspannung verschaffen, um die eine oder andere Stress-Falte zu beseitigen und nachts wieder ruhig schlafen zu können.

Parallel verspricht eine Horde von Tool-Vertriebsleuten goldene Zeiten, sobald man mit A/B-Testing beginne. Doch was passiert in Wirklichkeit?

Drei kritische Fragen an die Verantwortlichen

Auch wenn es nur vorläufige Ergebnisse aus 63 Rückläufern sind: Wir haben bereits interessante Rückschlüsse aus unserer Befragung auf der dmexco. Dort haben wir die E-Commerce-Verantwortlichen zum Thema CRO und Effektivität befragt. Unter anderem waren drei Fragen für uns besonders wichtig:

- Wie entwickelt sich Ihre Conversion Rate?

- Wie zufrieden sind Sie mit der Entwicklung der Conversion Rate?

- Haben Sie das Gefühl, die Conversion Rate kontrollieren zu können?

Der Vorab-Trend sagt:

- Redesigns und ähnliche Projekte versperren oft den Weg zu sinnvoller, inkrementeller Optimierung

- Know-how von außen ist für interne Optimierungs-Teams ein wichtiger Erfolgsfaktor

- Trotz zahlreicher A/B-Tests lässt sich im linearen Verlauf wenig oder kein Effekt messen

- Ein Großteil der Verantwortlichen im Markt sind mit der Entwicklung ihrer Conversion Rate unzufrieden

Woran liegt das?

Aus der Erfahrung von vielen hunderten A/B-Tests und mit dem unverstellten Blick in eine Vielzahl von Unternehmen lassen sich mehrere Gründe ausmachen, warum Optimierungsbemühungen in vielen Fällen leider “Bemühungen” bleiben. Hier sind die fünf häufigsten Testing-Fehler:

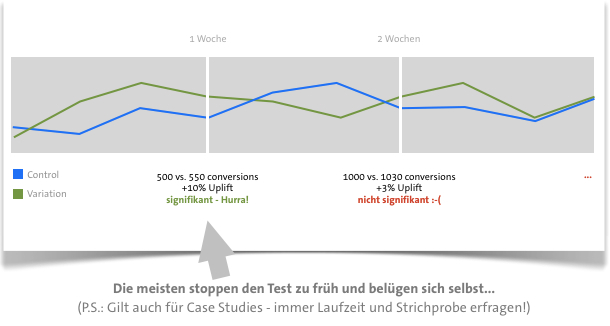

1) Der “Ich-belüge-mich-mit-falschen-Resultaten-selbst” Fehler

Die Tools sind nicht ganz unschuldig daran. Neulich dauerte es nur wenige Stunden, bis die Resultate in einem Test laut Tool bereits signifikant waren. “High Five! Winning Variation Found!” verkündet das Tool mit einem kleinen Pokal-Icon. Kann das sein?

Das Problem haben wir schon mehrfach erläutert: Unabhängig vom rein mathematisch errechneten Signifikanz-Wert (CTBO/CTBB) gibt es Anforderungen an die Laufzeit von Tests, damit Resultate auch wirklich valide werden. Ein großer Einfluss auf Testresultate ist die Traffic-Quelle: Besucher aus Newslettern sind häufig Bestandskunden und reagieren anders auf eine Variation als Neukunden. Es gibt TV-Werbung, unterschiedliches Wetter, am Anfang des Monats wird mehr Geld ausgegeben als am Ende.

Die Einflüsse sind also sehr vielschichtig und auch mit der ausgefeiltesten Segmentierung nicht in den Griff zu bekommen. Wer seinen Test zu kurz laufen lässt, der erhält nur einen kurzen, zufälligen Ausschnitt.

Daher gilt (stark vereinfacht): 14 Tage sind eine gute Mindest(!)-Testlaufzeit. In dieser Zeit sollte eine annähernd repräsentative Stichprobe erreicht werden. Tests während extremer SALE-Aktionen sollten vermieden werden – oder der Tests sollte außerhalb der Aktion wiederholt werden.

Wer es gerne agiler hätte, sollte lieber mehrere Tests parallel laufen lassen.

Warum versaut dieser Testing-Fehler das Wachstum?

Ganz einfach: Die “Gewinnervariante” war in Wirklichkeit oftmals gar kein Gewinner. Wäre der Test nur wenige Tage weiter gelaufen, wäre das Ergebnis “zusammen gelaufen”. Wer Tests zu früh stoppt, ist eventuell einem statistischen Artefakt auf den Leim gegangen.

Ergo: Ressourcen für den Test wurden verschwendet, falsche Resultate kommuniziert (die Enttäuschung kann sehr groß sein!) und im schlimmsten Fall wurde eine Veränderung ausgerollt, die überhaupt nichts bringt…

Bonus Blogpost zum Thema Statistik und warum die meisten MVT Resultate falsch sind: Die Conversion Lüge

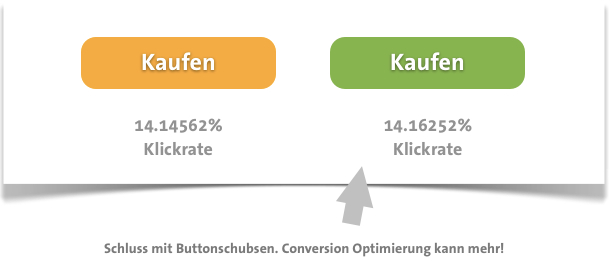

2) Der Irrelevanz-Fehler

Viel zu oft sehe ich bei Unternehmen in den Listen mit Testideen Themen à la “Wir wollen wissen, was passiert wenn wir diese Box von rechts nach links schieben”.

Was soll das bringen?

Wer von uns hat sich schon einmal dazu passend in der Nutzerrolle gedacht “also wenn die Box mit dem Zubehör jetzt rechts wäre, würde ich ja in dem Shop kaufen…”?

Ähnliches gilt für Tests unterschiedlicher Button-Farben und anderer Details. Solche Tests können gar keine Resultate bringen, die signifikant und nachhaltig das Wachstum beeinflussen.

Ich sehe das so: Eine Testvariante muss stark genug sein, um das Verhalten der Nutzer wirklich zu beeinflussen. Veränderungen, die dem nicht gerecht werden, können auch keine messbaren Resultate erzeugen.

Aus der Perspektive des Optimierers misst der A/B-Test eine Veränderung auf der Website. Das ist jedoch ein fataler Trugschluss. In Wirklichkeit misst das Testingtool die Folge geänderten Nutzerverhaltens. Eine Variation, die das Verhalten der Nutzer nicht ändert, kann auch kein Resultat im A/B Test bringen.

Warum versaut dieser Testing-Fehler das Wachstum?

Ganz einfach. Nehmen wir an, ein Shop erzeugt pro Monat 20.000 Orders. Für einen guten Test mit validen Resultaten brauchen wir mindestens 2 Wochen Laufzeit und wenigstens 1.000 Conversions pro Variation. Ein A/B-Test mit 5 Varianten verbraucht also schon 5.000 Orders. Wenn wir auf Nummer sicher gehen, sind es vielleicht auch 10.000 Orders. Wir haben also nicht mehr als zwei bis vier Testslots pro Monat, also maximal 20 bis 50 Testslots pro Jahr.

Wie viel Prozent der Tests liefern valide Resultate? Wie hoch ist der durchschnittliche Uplift?

Wer das durchkalkuliert, dem wird schnell klar, dass die wertvollen Testslots nicht für Banalitäten geopfert werden sollten. Je effektiver die Testhypothesen, desto mehr Uplift kann generiert werden.

In Wirklichkeit gibt es nämlich noch ganz andere beschränkende Faktoren für die Anzahl guter Testslots…

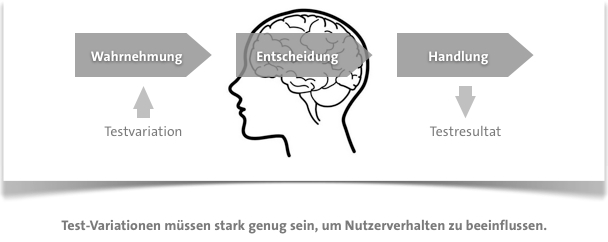

3) Fehlende Agilität

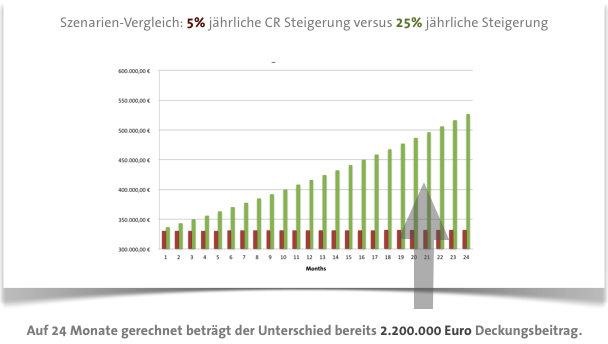

Agilität scheint zum Buzzword geworden zu sein. Dabei lässt sich die betriebswirtschaftliche Auswirkung fehlender Agilität leicht in Form von Opportunitätskosten ausrechnen.

Es ist also ganz einfach: Wer doppelt so viele erfolgreiche Optimierungssprints durchführen kann, hat doppelt so viel Erfolg. Der Unterschied zwischen diesen beiden Szenarien beträgt bereits 2,2 Millionen Euro Opportunitätskosten pro Jahr.

Dabei sind die Rahmenbedingungen recht konservativ: Es geht um ein einfaches Online-Business mit ca. 20 Millionen Euro Umsatz und 15% Marge.

Warum versaut dieser Testing-Fehler das Wachstum? Die häufigste Fragestellung lautet: “Sind denn 25% globaler und kumulierter Uplift pro Jahr durch Optimierungen überhaupt machbar?” Diese Fragestellung ist zwar grundsätzlich gerechtfertigt – verstellt jedoch den Blickwinkel. Für die meisten Verantwortlichen ist die Konversionsrate eine fixe Konstante – ein Sprung von 3% auf 4% scheint nur durch massive Preissenkungen oder Traffic-Kürzungen machbar. Dabei wird übersehen, dass es die Website ist, die verkauft. Wer alleine Traffic, Sortiment und Wettbewerb für die eigene Konversionsrate verantwortlich macht, hat meiner Meinung nach den größten Optimierungshebel übersehen.

Die richtige Frage müsste lauten:

“Was müssen wir tun, um 25% Uplift durch Optimierungen zu erreichen?”

Amazon hat im Jahr 2013 laut Geschäftsbericht fast 2.000 A/B-Tests durchgeführt. Eine unermessliche hohe Zahl, die sicherlich auch nur mit extrem viel Traffic überhaupt technisch möglich ist. Wie viele Erkenntnisse wird Amazon dadurch gewonnen haben? Wie viele Tests haben einen Uplift gebracht? Wie viele der Erkenntnisse sind ein strategischer Wettbewerbsvorteil?

Die Antworten darauf sollten den Blick auf die eigene Organisation schärfen und folgende Fragen aufkommen lassen:

Warum beschränkt die Organisation die agile Durchführung von Optimierungen? Wer hat ein Interesse daran? Was können wir tun?

Oft liegen in diesen Antworten bereits die ersten Ideen, um den Bann zu brechen…

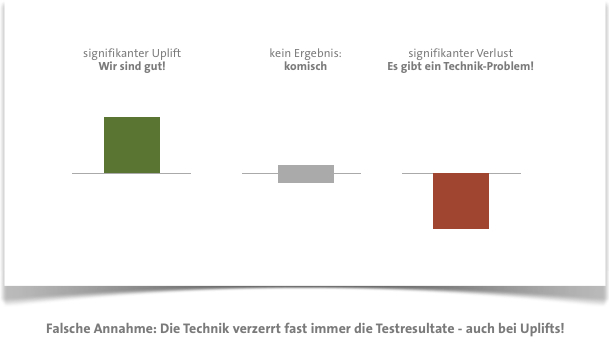

4) Der Technik-Fehler

Wer viel testet, der kennt das Gefühl: Schlechte Testresultate vermiesen die Laune. Für Conversion Optimierer haben auf einmal A/B-Tests größeren Einfluss auf das Wohlbefinden als das Wetter… 🙂

Ein häufiges Phänomen: Wenn der Test gut läuft, war es eine geniale Testidee.

Wenn der Test schlecht läuft, muss es ein Problem mit dem Testingtool geben.

Ganz im ernst: Auch gut laufende Tests leiden tatsächlich häufiger an Technik-Problemen, als man denkt. Es ist ja allgemein bekannt, dass Ladezeiten kritisch für ein positives UX und damit für die Conversion Rate sind.

Was passiert beim Testing mit Code Injection?

- Der Code wird geladen

- Am Ende des Ladevorgangs wird der DOM Baum manipuliert

- Das Frontend wird verändert, während der Nutzer bereits die Seite sieht

- Das Resultat: eine spürbare Verzögerung beim Seitenaufbau und Flacker-Effekte – eine schlechte User Experience

Auch diejenigen, die über Split-URL-Verfahren testen, sind nicht vor den Einflüssen der Ladezeit gewappnet. So wird der Redirect auf die Variation auch erst während des Ladens der Control-Variante ausgelöst.

Dieser technische Testing-Fehler belastet stets die Variation – und zwar in einem Bereich, der vielen nicht bekannt ist. So haben wir einen Test mit negativen Resultaten (Signifikant -5%) bezüglich Technik und Ladezeiten optimiert und das Ergebnis in einen +7% Uplift gedreht – bei gleicher Variation.

Daher gilt: Arbeiten Sie nur mit wirklich guten Frontend-Entwicklern und Testing-Experten zusammen, die diese Effekte beherrschen. Flacker-Effekte können vermieden werden. Die Ladezeiten können in einem Split-URL Test durch einfache A/A’/’B/B’-Tests heraus gerechnet werden.

Warum versaut dieser Fehler das Wachstum? Weil mit Sicherheit sehr viele Tests, die eigentlich gute Resultate geliefert hätten, als “klappt nicht” abgestempelt werden und auf der Müllhalde landen. Es wurde viel Zeit verloren, Ressourcen unnötig eingesetzt und – was am schlimmsten ist – falsche Rückschlüsse gezogen. Häufig spreche ich mit Unternehmen, schlage einen Test vor und höre “Das haben wir schon probiert – das klappt nicht.” Zum einen ist diese Argumentation an sich schon ein Wachstumskiller. Zum anderen waren es oft technische Details, die in Wirklichkeit nicht funktioniert haben…

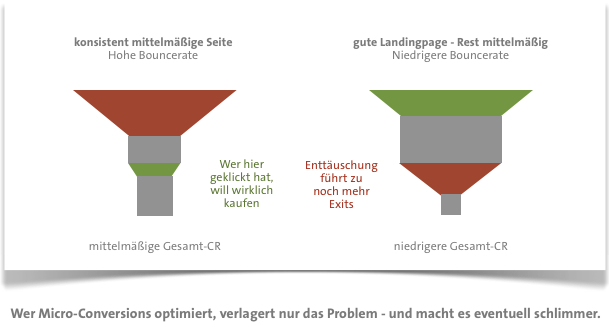

5) Der Fehler der falschen KPI

Häufig zitiertes Beispiel: Ich stehe vor einem Schaufenster und überlege, ob der Laden das passende Produkt zum passenden Preis hat. Dutzende implizite Signale lassen mein Hirn in Sekundenschnelle entscheiden, ob ich in den Laden hineingehe oder nicht.

Der erste Eindruck hat Einfluss auf meine Entscheidung.

Nehmen wir an, das Schaufenster sieht nicht besonders vielversprechend aus. Ganz ähnlich wie eine schlechte Landingpage. Würde der Ladenbesitzer sein Schaufenster aufpolieren, sagen wir mal um einen hochwertigeren Eindruck zu erzielen, würde mich das eventuell eher dazu bewegen, den Laden zu betreten.

Da er aber nur das Schaufenster optimiert hat (also seine Landingpage) und der Rest des Ladens noch genauso ramschig und schlecht ist wie vorher, werde ich nun um so enttäuschter sein.

Die höhere Micro-Conversion hat im Anschluss einen gegenteiligen Effekt. Man könnte es auch als einen Fall von Erwartungsmanagement oder Konsistenz bezeichnen.

Doch leider wird online dieser Fehler immer wieder gemacht:

Warum versaut dieser Fehler das Wachstum? Weil im häufigsten Fall angebliche Verbesserungen ausgerollt werden, die sogar der Conversion Rate schaden. Es wurden unnötig Ressourcen für Tests verschwendet, Zeit verloren und das Gesamtergebnis verschlechtert.

Vor allem mittlere und kleine Unternehmen, die nicht genügend Conversions für A/B-Testing haben, optimieren auf Klicks und die Reduzierung der Bounce Rate. Denjenigen sei geraten, die Gesamt-Conversions bei Tests dennoch zu messen und sehr genau im Auge zu behalten. Einziger Trost: Die Erkenntnisse aus Landingpage-Tests lassen sich nutzen und im weiteren Verlauf des Funnels (hoffentlich) erfolgreich einsetzen.

Ergänzung: Das gleiche gilt im E-Commerce für das Verhältnis zwischen Bestellungen (Brutto-Umsatz) und Retouren (Netto-Umsatz). Letzteres wird leider viel zu oft nicht gemessen und ausgewertet – auch hier kann ein Nicht-Erfüllen der Erwartungen den Gesamt-Deckungsbeitrag senken. Der Beweis findet sich in dieser Studie.

Bonus-Tipp:

6) Der “Wir-haben-keinen-Businessplan-für-Optimierung”-Fehler

Zu guter Letzt ein ganz einfacher Sachverhalt. Weiter oben sprach ich von jährlich +25% Conversion Rate Uplift und zeigte, was im Gegensatz dazu passiert, wenn nur 5% erreicht werden.

Ein Gedankenspiel:

- Optimierung kostet Ressourcen, Zeit und Geld. Die Optimierungs-Slots sind begrenzt und damit kostbar.

- Das Ziel der Optimierung ist ein betriebswirtschaftlich messbares Resultat – ein ROI.

- Wenn sich Kosten und Nutzen also festlegen und auch kontrollieren lassen – warum gibt es keinen Business- oder Investitionsplan für Optimierungsmaßnahmen?

Wer kein Ziel hat, der kann es gar nicht erreichen.

Sorry, wenn das jetzt ein wenig schnell ging. Ich glaube ganz einfach, dass viele Unternehmen kein Wachstum durch Optimierung erreichen, weil sie plan- und ziellos herumoptimieren.

Fazit

Vielerorts wird optimiert und die Resultate werden mit A/B-Testing validiert. Doch leider gibt es genügend Einflussfaktoren in Form dieser Testing-Fehler, die den ROI der Maßnahmen senken – völlig unnötig. Wer alleine diese fünf Themen beherrscht und sich einen Businessplan zurechtlegt, kann mit nachhaltigem und effektivem Wachstum rechnen.

Weiterführende Blogposts

Gute Vorsätze reichen nicht: Der Conversion Survival Check 2014

2 Kommentare

Markus Kehrer,

Hallo André,

mal wieder ein super Artikel, am Besten finde ich das Visual mit Batman 🙂

Grüße

Markus

Marco Schumacher,

Hallo André,

vielen Dank für den super Artikel. Vor allem der Punkt zum Technik-Fehler war spannend. Wir werden stärker versuchen die Flickr-Fehler etc. zu minimieren.

Eine Frage zu Punkt 1:

Die schriebst: “…sollte lieber mehrere Tests parallel laufen lassen”. Wir diskutieren gerne intern, ob es in Ordnung ist, dass 5 A/B-Tests parallel laufen dürfen, wenn sie sich nur minimal überschneiden (LP, Header, Kategorie, Produktseite, Check-Out). Oder ob diese sich dann doch zu sehr beeinflussen und die Ergebnisse kritischer betrachtet werden müssen.

Wie siehst du da die Beeinflussung untereinander statistisch gesehen?