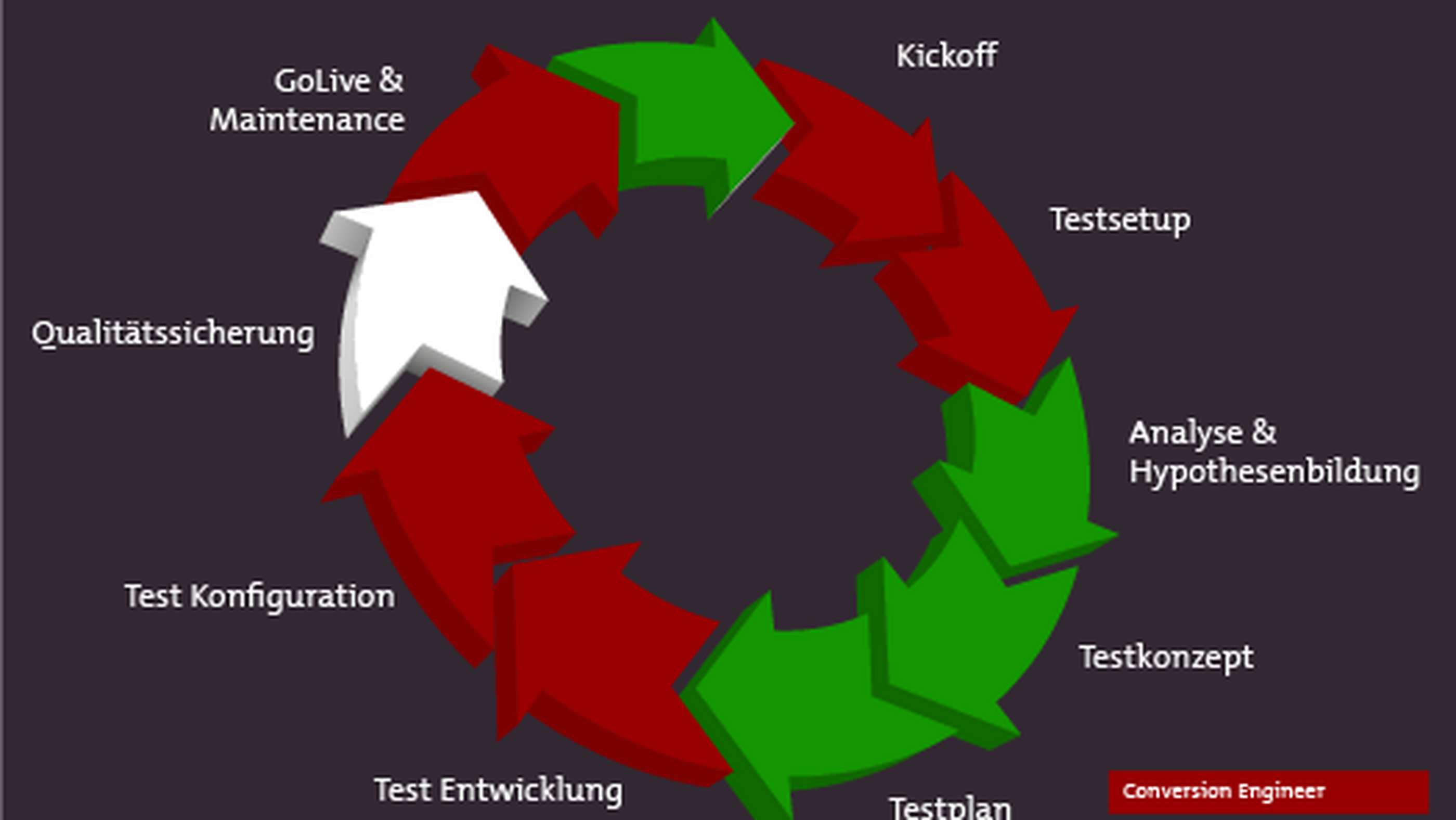

Jeder A/B Test ist ein Eingriff in ein wertschöpfendes System und daher meist kritisch zu betrachten. Der in diesem Artikel beschriebene Workflow hat sich daher in den letzten Jahren als “Best-Practice” abgezeichnet, um einen risikofreien und erfolgreichen Test zu ermöglichen.

Die folgenden 10 Schritte bilden das Fundament für erfolgreiche Testingprojekte:

1 – Der Kickoff

Im Kickoff werden die Ziele, Verantwortlichkeiten, Zeitplan, Rahmen- und Testbedingungen festgelegt. Dabei stellen sich Fragen wie die folgenden:

Wo soll getestet werden?

Was soll getestet werden?

Was sind die Ziele?

Wie lange soll der Test etwa laufen?

Der Kickoff kann für mehrere Tests gelten und muss nicht zwangsläufig bei jeder Testrunde stattfinden.

2 – Das Testsetup

Auch das Testsetup ist ein Schritt, welcher in der Regel nur einmal durchgeführt wird. Im Setup wird ggf. das Tool evaluiert und entsprechend implementiert.

Wichtig: In diesem Schritt findet die Validierung der Testintegration statt, also die Kontrolle ob Variation korrekt ausgespielt werden und das Conversion Tracking zufriedenstellend funktioniert.

Der Aufwand hierfür hängt im wesentlichen von den folgenden Faktoren ab:

Testingtool (<;tag>;-basiert, Proxy-basiert usw.)

Komplexität der eCommerce Umgebung

Art und Anzahl der Conversion Goals

3 – Analyse und Hypothesenbildung

Dieser Schritt ist der wichtigste Prozessschritt. Hier unterscheiden wir zwischen:

Quantitative Analyse

Dabei werden quantifizierende Gesichtspunkte analysiert, wie z.B. Zahlen aus Webanalyse:

Wo sind hohe Exit- bzw. Bouncerates

Wo ist genug Traffic um ausreichend “Futter” zum Testen zu haben(Traffic ist nebenbei eine wichtige Grundvoraussetzung um überhaupt vernünftig testen zu können, er hat Einfluss auf die mögliche Anzahl an Variation im Test, ob Multivariat getestet werden kann und wie lange der Test voraussichtlich laufen muss, um valide Zahlen zu generieren.)

Qualitative Analyse

Bei der qualitativen Analyse setzen wir den Nutzer in den Fokus – in unserem Fall in der Regel durch Befragung und Eyetracking. Damit werden potenzielle Baustellen und mögliche Optimierungen aufgedeckt.

Experten Evaluation

Die Experten Evaluation ist auch eine qualitative Analyse – basiert aber nicht auf Nutzermeinungen sondern wird auf Usability Heuristiken, 7 Ebenen Modell, Psychologischen Triggern und letztlich auf Erfahrungswerten aufgebaut.

Idealerweise sollten alle drei in die Konzeption einfließen.

Sind die potenziellen Baustellen identifiziert, so findet als nächstes die Hypothesenbildung statt. Diese bildet den wesentlichen Erfolgsfaktor für jeden Tests. Wie wichtig das ist hat mein Kollege André Morys kürzlich in seinem Artikel über “Die Testing-Falle, in die jeder mal tappt” oder auch “5 grobe Testing-Fehler, die viel Geld kosten können” beschrieben.

In der Regel wenden wir bei der Hypothesenbildung das 7-Ebenen-Modell und einen Baukasten aus Psychologischen Triggern an. Mit welchen Hypothesen man die Optimierungen und Testvariationen bzw. -faktoren stützt, bleibt natürlich jedem selbst überlassen.

4 – Das Testkonzept

Das Testkonzept ist eine Zusammenstellung der Hypothesen und der Ergebnisse aller vorhandenen Analysen. Sofern die Machbarkeit der geplanten Testinhalte nicht schon im Rahmen der Hypothesenbildung durch einen Conversion Engineer eingeschätzt wurde, so sollte diese hier spätestens stattfinden.

5 – Der Testplan

Mit dem Testplan – welcher das Produkt der Konzeptionsphase ist – werden die einzelnen Maßnahmen ausgestaltet und entsprechend dokumentiert.

Er ist die Grundlage für die Umsetzung und das Herzstück des Tests. Mit ihm steht und fällt das Testkonzept. Er sollte die folgenden vier Fragen beantworten:

Was wird getestet?

Wann, zeitliche Abfolge?

Wie? Welche Art der Tests? A/B, MVT, Split-URL etc.

Wo, auf welchen Seiten?

Er sollte die Variationen (A/B-Test) bzw. Variablen/Faktoren (MVT) dokumentieren und deren Ausgestaltung oder zumindest Wireframes beinhalten.

Besonders bei MVTs ist der Testplan sehr wichtig, weil hier bereits die Kombinierbarkeit von Variablen innerhalb von definierten Sektionen berücksichtigt werden müssen. Dabei stellen sich Fragen wie

Lassen sich die Variablen so kombinieren?

Kommen sich Variablen möglicherweise in die Quere, wenn Sie gleichzeitig ausgespielt werden?

Stehen Inhalte bei allen Variablen so zur Verfügung, dass diese hier bedenkenlos ausgespielt werden können?

Häufig wird an dieser Stelle der Fehler gemacht, dass das Testkonzept den “Idealzustand”, z.B. nach einer erfolgten Iteration beschreibt. Anschließend bzw. nachträglich werden die Veränderungen in Bereiche eingeteilt, welche aus verschiedenen Variationen bestehen können. Hier kann es potenziell zu Konflikten kommen. Sollte dem so sein, so sollte besser ein A/B/n-Test realisiert werden, welcher entsprechend weniger Variationen beinhaltet, aber dafür reibungslos funktioniert. Wann generell eher ein A/B Test und wann ein MVT sinnvoller ist, wurde in den oben aufgeführten Artikel bereits hinreichend beschrieben.

6 – Die Test Entwicklung

In diesem Schritt findet die Umsetzung des Testplans, zielgerichtet und möglichst effizient statt.

Für uns hat sich folgender Workflow heraus kristallisiert:

Testseiten offline verfügbar machen

Auch wenn man vollen Zugriff auf die Templates, das CMS etc. hat, macht sich zumindest unserer Erfahrung nach das offline arbeiten bezahlt. Hier kann einfach und schnell das JavaScript, CSS und HTML für den Test entwickelt und exemplarisch im Testsumfeld angewendet werden kann.

Die Entwicklung im Testingtool direkt ist mühsam, zeitintensiv und maßgeblich von der Performance des Tools bzw. Editors abhängig.

Variationen / Variablen in HTML, JavaScript und CSS umsetzen

Die lokale Umsetzung sollte hier mit besonderem Augenmerk auf die Performance stattfinden.

Kombinations- & CrossBrowser Check

Auf Entwicklungsebene sollte an dieser Stelle bereits geprüft werden, ob alle Variationen (A/B-Test) wie gewünscht ausgespielt und sich Variation (MVT) problemlos kombinieren lassen. Außerdem sollte jetzt schon der Blick über den Tellerrand zu anderen Browsern schweifen, um schon möglichst früh die CrossBrowser Kompatibilität zu waren. Es empfiehlt sich anhand der Zahlen aus der Webanalyse zu bewerten, bis welche Browser man Abwärtskompatibel sein sollte, und welche man schlicht vom Test ausschließt.

7 – Die Test Konfiguration / PreLive Test

In diesem Schritt wird der Test im Tool angelegt, sofern dies nicht schon beim Test Setup im Rahmen der Validierung erforderlich war.

Hier werden jetzt alle umgesetzten Variationen im Tool eingepflegt, die Conversion Ziele definiert und der Test eingerichtet. Testingtool übergreifend hat sich für uns folgender Ablauf abgezeichnet.

Test Initialisierung

Testumgebung (z.B. URLs)

Segmentierung (z.B. Ausschluss von Browser, Kampagnen etc.)

Traffic Verteilung (auf Variationen bzw. den Test insgesamt)

Conversion Ziele

Variationen / Variablen anlegen

Hier werden die einzelnen Variationen angelegt und der Code aus der Umsetzung eingepflegt.

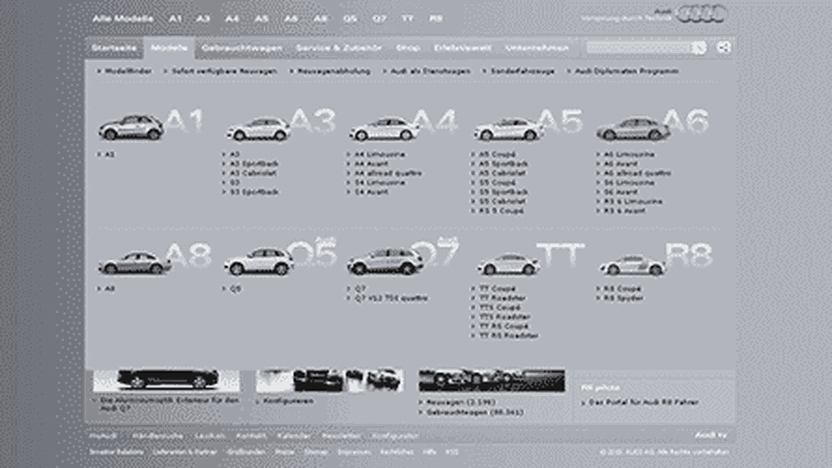

Test in Live-Umgebung verproben

Dieser Schritt ist noch keine vollwertige Qualitätssicherung, sondern mehr die Probe, ob die offline entwickelten Manipulation der “echten” Umgebung stand halten. Gerade auf dynamischen Seiten wie Kategorie, Suchergebnis, Checkout etc. ist dieser Schritt besonders wichtig.

Hierbei sollten stichpunktartig einzelne Variationen und Kombinationen geprüft werden, um sicher zu stellen, dass das Testkonzept in der Testumgebung reibungslos funktioniert.

Damit der Eindruck valide ist, sollte dieser Test – analog zur finalen QS – nicht in der Preview des Tools sondern in der echten Umgebung stattfinden. Sofern kein Stagingsystem oder andere Testinstanzen zur Verfügung stehen, auf welchen Gefahrlos die Tests ausgespielt werden können, so bietet sich hier eine entsprechende Segmentierung an – beispielsweise per URL-Parameter oder Cookie. Damit lässt sich der Test für eine eingeschränkte Zielgruppe Live schalten.

8 – Finale Qualitätssicherung

Die finale QS ist essenziell und hat maßgeblich Einfluss auf den Erfolg des Testlaufs. Die QS bei Testingprojekten ist besonders kritisch, da meist Manipulationen an dafür nicht vorgesehenen Stellen durchgeführt werden. Kleine Änderungen können oft sehr schnell großen Schaden anrichten. Deshalb gilt der QS eine besonders hohe Aufmerksamkeit.

Erfahrungsgemäß sollte auf keinen Fall der verantwortliche Engineer diese durchführen – wer findet schon gerne seine eigenen Fehler. Jemand der das Projekt begleitet, das Testkonzept und die damit verbunden Hypothesen kennt ist hierfür weit weniger betriebsblind und deutlich besser geeignet.

Idealerweise begleitet das Qualitätsmanagement den kompletten Prozess, vom Kickoff bis hin zur finalen QS, um auch die Qualität der Hypothesen und Umsetzung insgesamt zu gewährleisten.

Ein Tipp am Rande: Ein QS-Protokoll, welches die gängigen Punkte abdeckt erleichtert die Sichtung deutlich – gerade wenn häufiger Tests durchgeführt werden sollen.

9 – GoLive & Maintenance

In dieser Phase geht der Test letztlich Live. Oft reicht es hier die Zugriffszahlen zu flushen und die für die QS eingesetzte Nutzersegmentierung zu entfernen, so dass der Test für die Öffentlichkeit zugänglich wird.

Im Verlauf des Tests – gerade am Anfang – gilt es besonders kritisch die Zahlen im Auge zu behalten. Technische Probleme fallen spätestens jetzt auf. Gerade in komplexen Umgebungen können nicht bedachte Zustände auftreten, welche sich in den Zugriffen und Conversions abzeichnen.

Empfehlenswert ist hier besonders die Webanalyse im Auge zu behalten, am besten durch erfolgte Koppelung mit dem Testingtool. Meist lassen sich durch Custom Variablen oder direkte Schnittstellen der Test in der Webanalyse identifizieren (z.B. Test-Bezeichnung und Variation). Dadurch lassen sich auch Metriken, wie Exit-, Bouncerates, Browser, Pagesviews, Klickpfade etc. bewerten, welche in Testingstools in der Regel nicht oder nur eingeschränkt zur Verfügung stehen.

10 – Ergebnisse interpretieren / Tweaking

Im letzten Schritt werden die Zahlen interpretiert und entsprechende Ableitungen getroffen. Zeigt ein Test nicht den gewollten Effekt, so lässt sich hier nachbessern (Tweaking).

Generell gilt: Keine Angst vor schlechten Zahlen. Auch ein schlecht laufender Test bietet Learnings – wenn auch z.B. dass die Hypothese ggf. nicht funktioniert. Aus jedem Ergebnis, egal ob positiv oder negativ – lässt sich etwas lernen. Die beiden bereits erwähnten Artikel beschreiben diesen Umstand im Detail.

Hat ein Test die gewünschte Validität erreicht, anhalten und Ergebnis ausrollen.

Fazit

Der skizzierte Prozess ist mit seinen 10 Schritten letztlich die Bestpractice für unsere Testing-Projekte, welche häufig komplexerer Natur sind und einen geregelten Ablauf erfordern.

Wer auf die folgenden Kernpunkte achtet, hat gute Chancen ein erfolgreichen Testlauf durchzuführen:

Das Testkonzept sollte Hypothesen gestützt sein

Quantitative und Qualitative Analysen sollten in das Konzept einfließen

Der Test sollte nicht als solcher wahrgenommen werden

Finale Qualitätssicherung in der Live-Umgebung ist essenziell

Welche Erfahrungen haben Sie bei Testingprojekten gesammelt? Über Ihr Feedback würde ich mich freuen.